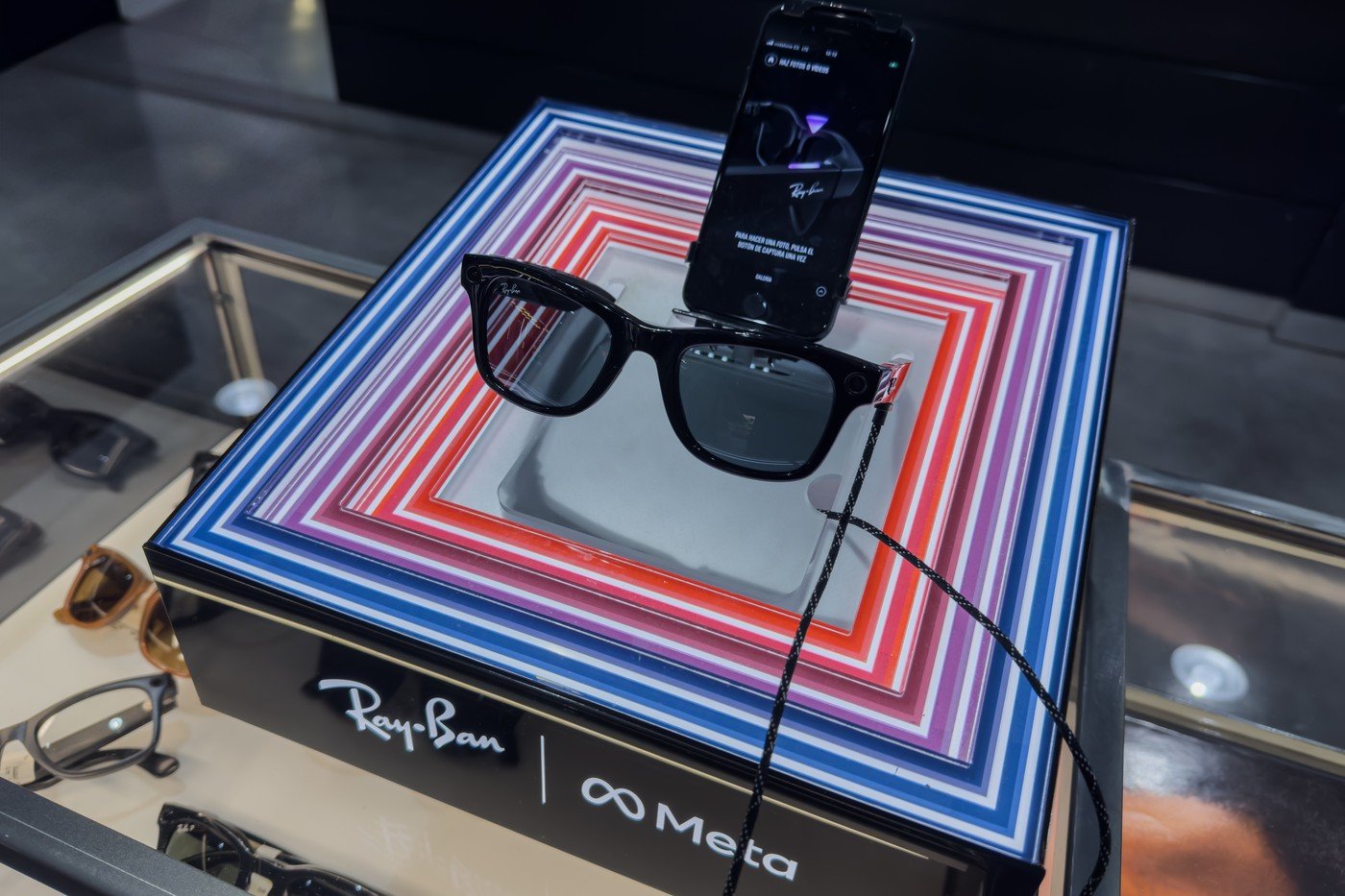

Ochelarii inteligenți Ray-Ban AI, dezvoltați de Meta, au stârnit rapid o reacție spaimă și controversy în lumea tehnologiei și a drepturilor individuale. Înregistrările și analiza datelor realizate cu ajutorul acestor dispozitive au depășit rapid așteptările de vânzări, ajungând în circa șapte milioane de perechi comercializate doar în 2025. În ciuda succesului comercial incontestabil și a avansului tehnologic, această creștere a atras atenția asupra problemelor legate de confidențialitate, decontaminare a datelor și etică în domeniul inteligenței artificiale și al colectării de informații personale.

Confidențialitate sub semnul întrebării: ce se întâmplă cu datele înregistrate?

Hardware-ul acestor ochelari permite utilizatorilor nu doar să înregistreze imagini din primele persoane, ci și să analizeze mediul înconjurător cu ajutorul AI-ului dezvoltat de Meta. Aceasta tehnologie promite să furnizeze o experiență de realitate augmentată, dar dezvăluirile recente sugerează un alt nivel de complexitate și potențial pericol. O investigație comună, realizată de ziare suedeze, a scos la iveală faptul că o parte considerabilă din datele colectate ajung pe mâna contractanților din țări precum Kenya, unde sunt supuse unui proces manual de etichetare. Aceste angajați sunt nevoiți să revizuiască imagini extrem de intime și, uneori, traumatizante, precum scene din toalete sau chiar activități sexuale, fără consimțământ explicit și cu puține informații despre modul în care aceste date vor fi utilizate ulterior.

Unul dintre muncitorii angajați de firma Sama, care se ocupă cu revisionarea datelor, a relatat cu sinceritate: „Am văzut un videoclip în care un bărbat puse ochelarii pe noptieră și părăsea camera. La scurt timp, soția lui intra și se schimba de haine.” Aceste declarații evidențiază un gol flagrant în modul în care utilizatorii sunt informați despre modul în care datele lor sunt colectate și gestionate, și ridică serioase semne de întrebare despre respectarea intimității și drepturilor fundamentale.

Implicații etice și riscuri de exploatare a muncii

Una dintre cele mai alarmante aspecte ale acestei practici este volumul de muncă și condițiile de lucru ale contractanților. Ei sunt plasați sub presiunea de a continua reviziile rapid și eficient, riscănd ulterior concedierea dacă refuză sau nu pot ține pasul. În plus, termenii și condițiile Meta, pe baza cărora acești angajați își desfășoară activitatea, sunt redactați în litere mici, aproape ilizibile, și favorizează compania în detrimentul drepturilor muncitorilor și ale utilizatorilor.

Avocatul Kleanthi Sardeli, reprezentând organizația nonguvernamentală „None Of Your Business”, a atras atenția asupra faptului că, odată ce datele sunt încărcate în modelele AI, utilizatorii pierd orice control practic asupra lor: „După ce materialul este introdus în modelele, utilizatorii devin complet vulnerabili, fără posibilitatea de a controla modul în care informațiile lor sunt utilizate sau stocate.”Această situație scoate în evidență lipsa de transparență și posibilele abuzuri, precum și exploatarea în mod sistematic a forței de muncă în rețelele globale de moderare a conținutului, o practică tot mai criticată în domeniul digital.

Perspective și urmări

Pentru moment, Meta și alte companii din domeniu continuă să apere aceste tehnologii, invocând beneficiile pentru utilizatori și inovațiile în domeniul realității augmentate. Însă, scandalurile recente ar putea determina o reevaluare a politicilor de confidențialitate și a responsabilității sociale în crearea unor tehnologii atât de invazive.

Deși nu există încă o reacție ferme din partea autorităților de reglementare, opinia publică și organizațiile pentru drepturile omului devin tot mai active în solicitarea unor standarde clare de transparență și responsabilitate. Într-o lume în care tehnologia avansează vertiginos, provocările etice și legale devin tot mai stringente, iar cazul acestor ochelari inteligenți evidențiază nevoie urgentă de reguli clare care să protejeze atât intimitatea individuală, cât și muncitorii din spatele scenei digitale.