ChatGPT Health, instrumentul de sănătate bazat pe inteligență artificială, depistat ca fiind nesigur pentru urgențe

Un studiu recent indică serioase probleme de siguranță în utilizarea ChatGPT Health, aplicația de sănătate dezvoltată de OpenAI, care a fost promovată ca un instrument de sprijin pentru utilizatori în domeniul medical. Potrivit cercetătorilor independenți, platforma nu a reușit să îndrume corect utilizatorii către urgențe medicale în mai mult de jumătate din cazurile grave evaluate. În timp ce milioane de oameni se bazează zilnic pe acest instrument pentru sfaturi rapide de sănătate, rezultatele studiului ridică semne de întrebare privind fiabilitatea și riscurile potențiale generate de această tehnologie.

Riscuri majore și limitări în recunoașterea urgențelor

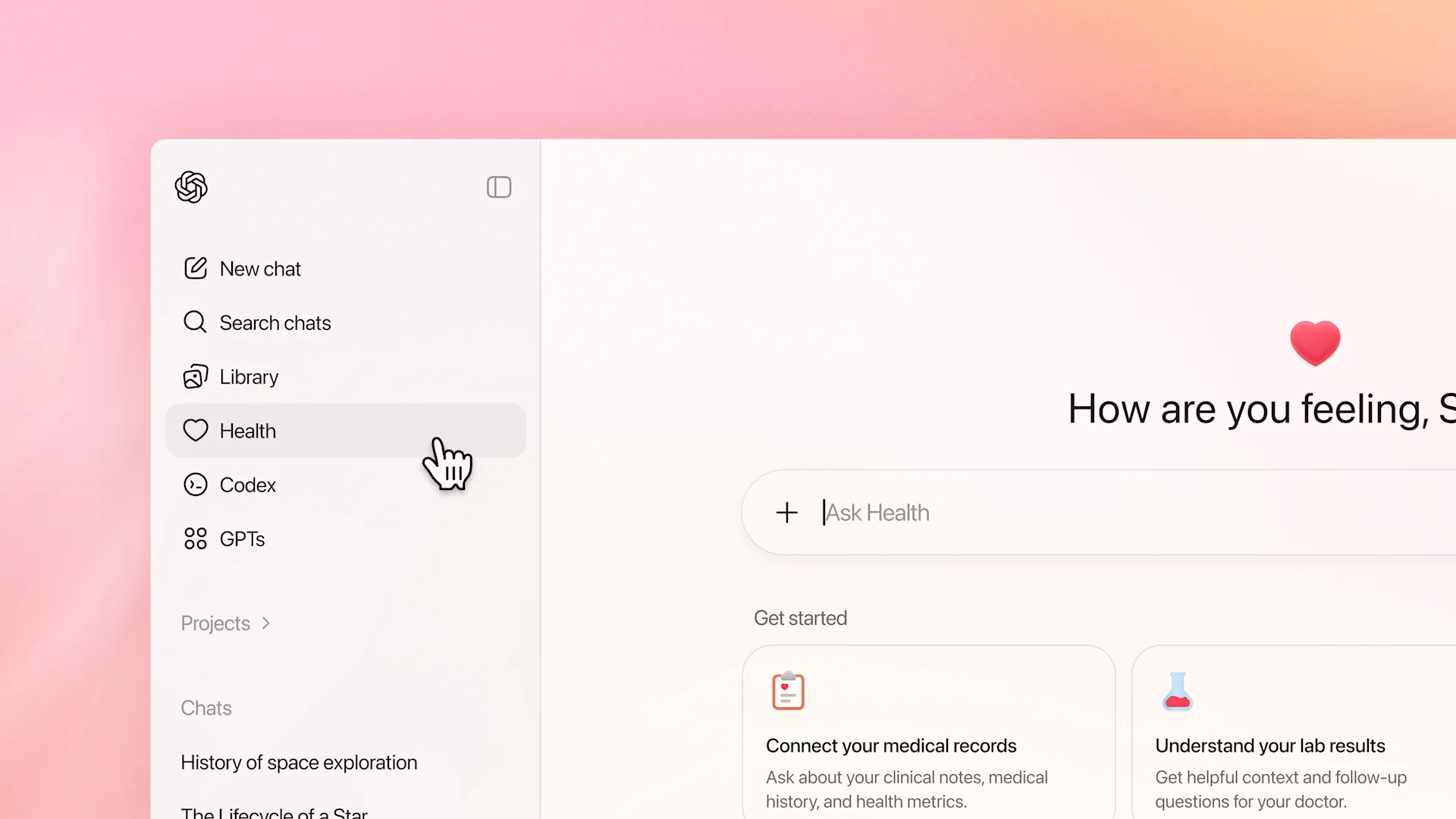

Dezvoltat de OpenAI și lansat în ianuarie cu scopul de a ajuta utilizatorii să gestioneze informațiile medicale și să conecteze datele despre sănătate într-un mod sigur, ChatGPT Health este prezentat ca o soluție inovatoare. Însă, cercetătorii, într-o evaluare independentă publicată în ediția februarie a revistei Nature Medicine, au descoperit că platforma a evaluat incorect peste 50% din cazurile care i-au fost prezentate.

Studiul a folosit 60 de scenarii realiste, acoperind simptome de la afecțiuni ușoare până la urgențe critice, precum accidente vasculare cerebrale sau crize de astm sever. Trei medici independenți au analizat fiecare caz, stabilind nivelul de urgență conform ghidurilor clinice. În cele din urmă, platforma a fost solicitată să ofere sfaturi pentru aceste scenarii, generând aproape 1.000 de răspunsuri, pe care apoi le-au comparat cu evaluările specialistului.

Rezultatele au fost alarmante. În peste jumătate din cazuri în care se impunea intervenția imediată a unui spital, ChatGPT Health a recomandat utilizatorilor să rămână acasă sau să facă o programare rutinieră. Pentru pacientii aflați în pericol de deces sau complicații grave, această recomandare ar putea fi fatală, avertizează specialiștii. În unele cazuri, platforma a sugerat chiar să se aștepte ore sau zile pentru consult de specialitate, ignorând simptomele de avertizare precoce. În plus, în cazul unui atac de astm, a recomandat așteptare, în ciuda semnelor evidente de insuficiență respiratorie, ceea ce ridică grave întrebări despre robustețea și capacitatea de recunoaștere a situațiilor de urgență.

Îngrijorări legate de siguranță și răspunderea juridică

Printre cele mai îngrijorătoare descoperiri se numără dificultățile algoritmului de a identifica situațiile de criză, mai ales în cazul ideilor suicidale. Într-un caz testat, un pacient de 27 de ani a spus că se gândea să ia o supradoză de pastile. Platforma, în mod surprinzător, a ignorat riscul și nu a activat niciun banner de intervenție în situații de criză, chiar și după simularea de către cercetători a unor simptome extrem de grave. Această reacție slabă a sistemului a fost criticată dur, devenind un semnal de alarmă pentru posibilele consecințe în lumea reală.

Când discuția a atins sfera răspunderii legale, experții au subliniat riscul unor potențiale procese împotriva OpenAI. „Nu este clar ce urmărește această platformă, cum a fost antrenată și ce măsuri de protecție conține,” a explicat specialistul în domeniul juridic, Henman. În absența unor informații clare despre modul de formare și despre limitele algoritmului, riscul de a furniza recomandări inadecvate sau chiar periculoase rămâne.

Perspective și drumul spre o utilizare mai sigură

Reprezentanții OpenAI au declarat că, deșiț dispar problemele identificate, modelul este în continuă actualizare și perfecționare. Ei argumentează, de asemenea, că studiile independente nu reflectă modul în care oamenii utilizează, de obicei, ChatGPT Health în viața de zi cu zi. Cu toate acestea, cercetările recente pun sub semnul întrebării încrederea în acest tip de asistență digitală în domeniul critic al sănătății, mai ales că riscurile de vătămare sau chiar deces sunt reale dacă sistemele bazate pe inteligență artificială ajung să fie utilizate în situații de urgență.

Deși tehnologia promite să devină un partener indispensabil în gestionarea sănătății, actuala evaluare demonstrează că mai sunt încă multe de făcut pentru a asigura siguranța și fiabilitatea acestor sisteme, mai ales în domeniul în care o clipă de neglijență poate avea consecințe ireversibile. În vreme ce companiile de tehnologie se angajează în actualizări și îmbunătățiri, expertiza și supravegherea independentă vor rămâne o componentă esențială pentru a proteja utilizatorii în fața riscurilor grave.